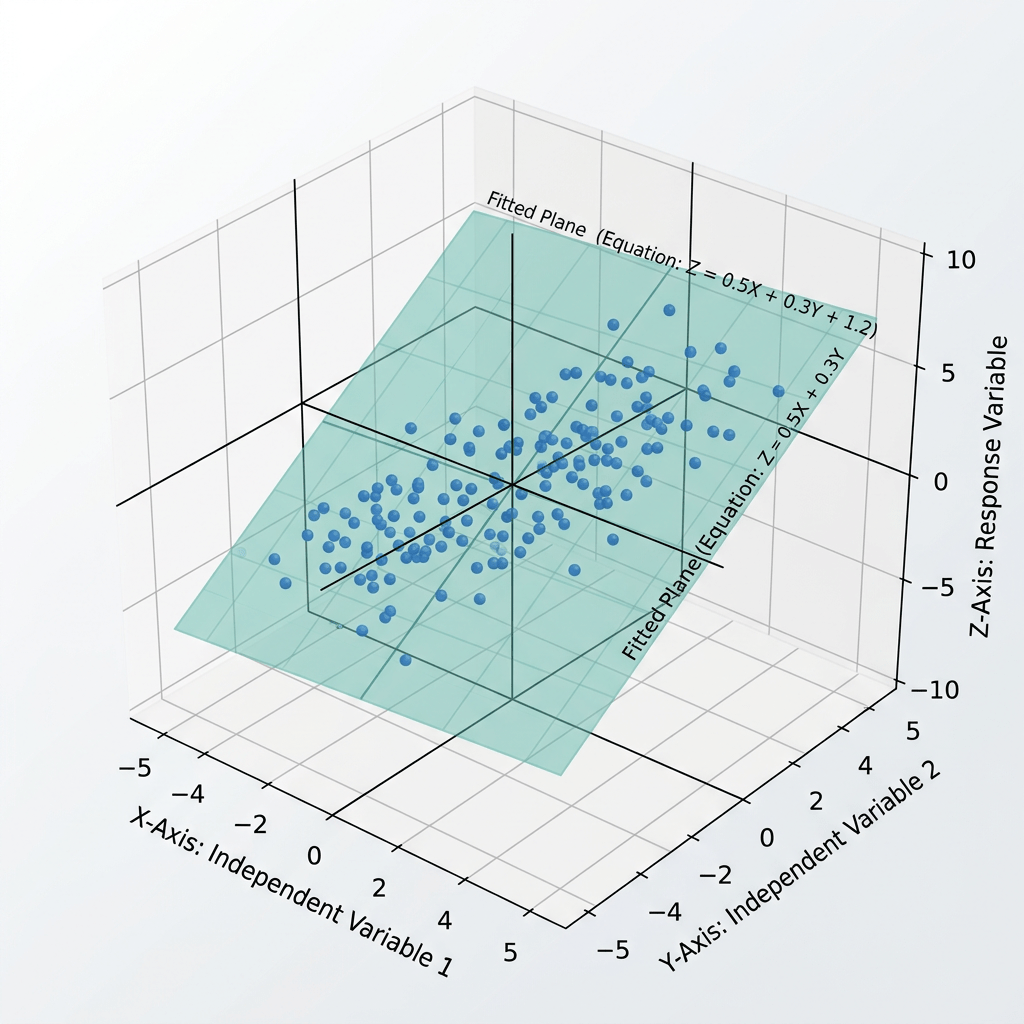

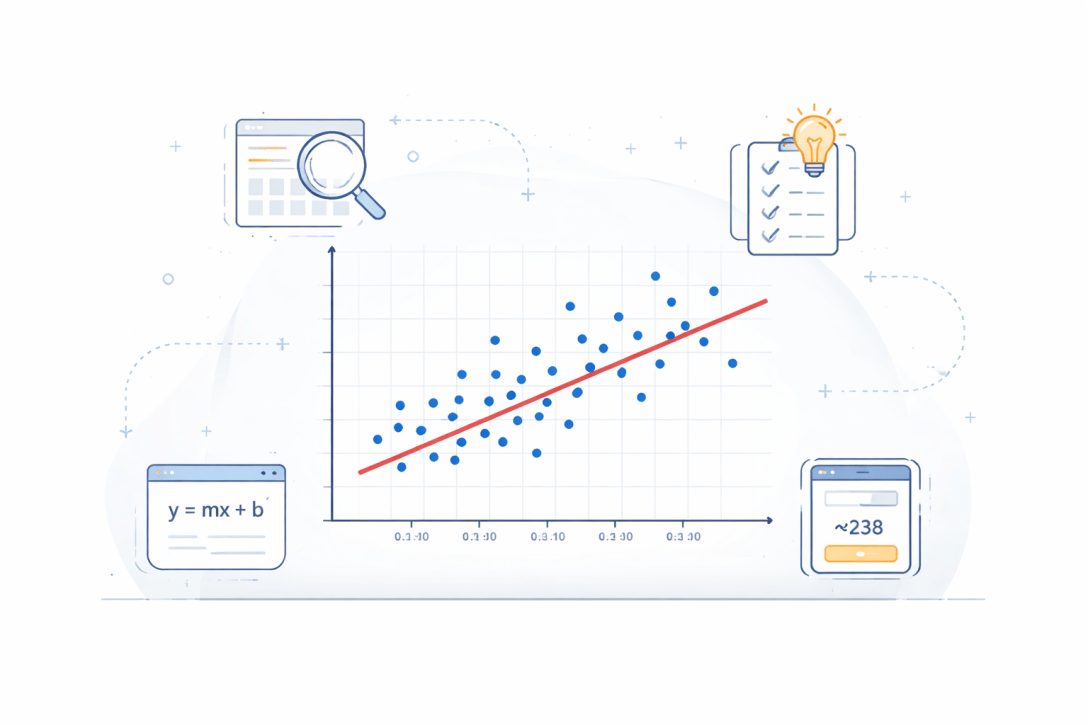

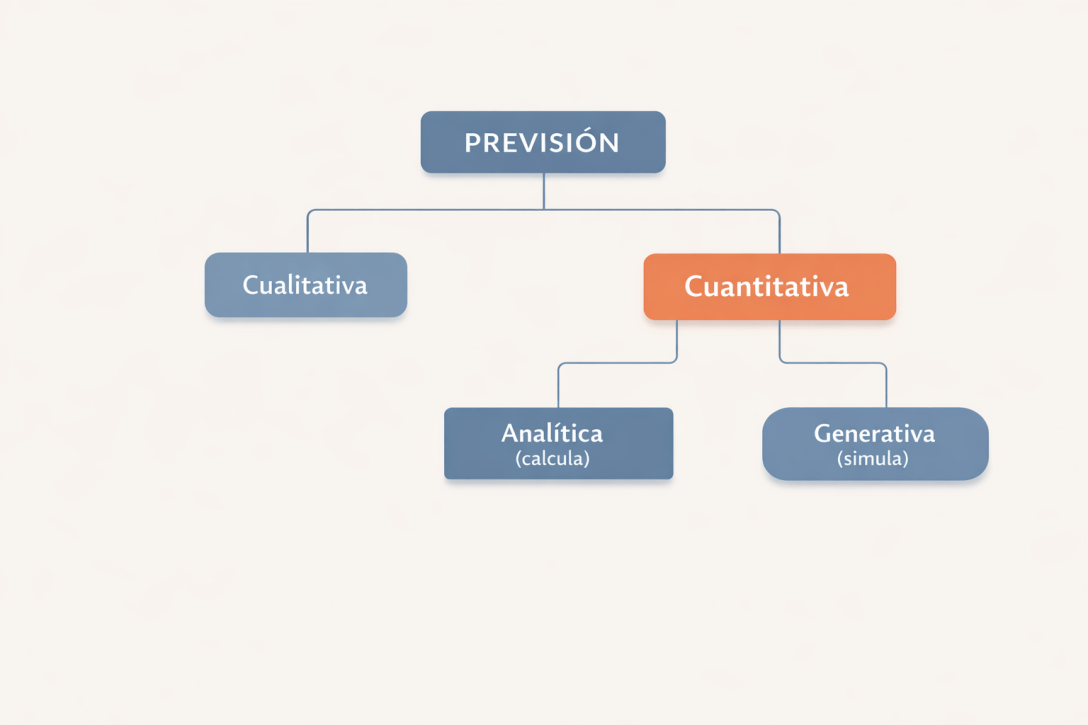

En predicción cuantitativa, el primer reto no suele ser elegir un algoritmo complicado, sino formular bien el problema. Antes de entrenar un modelo, hay que decidir qué queremos predecir, cómo vamos a medirlo y qué información puede ayudarnos a anticiparlo.

Con esa idea he preparado un nuevo proyecto en GitHub aplicado a un problema de gestión de personal hospitalario: la predicción mensual de nuevas bajas maternales equivalentes de trabajadoras de un hospital. La pregunta es concreta: ¿podemos estimar cuántas nuevas bajas maternales equivalentes se producirán cada mes entre las trabajadoras de un hospital usando datos agregados sobre plantilla, estabilidad contractual, estructura familiar aproximada y riesgo durante el embarazo?

El objetivo no es predecir decisiones individuales ni explicar la maternidad como fenómeno personal. El proyecto se centra en algo más práctico: construir una estimación mensual agregada que pueda ayudar a planificar sustituciones, prever carga organizativa y reducir parte de la incertidumbre en la gestión de personal.

Seguir leyendo «Predecir nuevas maternidades mensuales: un proyecto de regresión lineal múltiple paso a paso»