Blog sobre predicción estadística, inteligencia artificial y visualización de datos. Aprende a pensar como un zorro: con modelos flexibles, probabilidades bayesianas y sentido crítico.

El Método Delphi: cuando la predicción cualitativa se vuelve estructurada

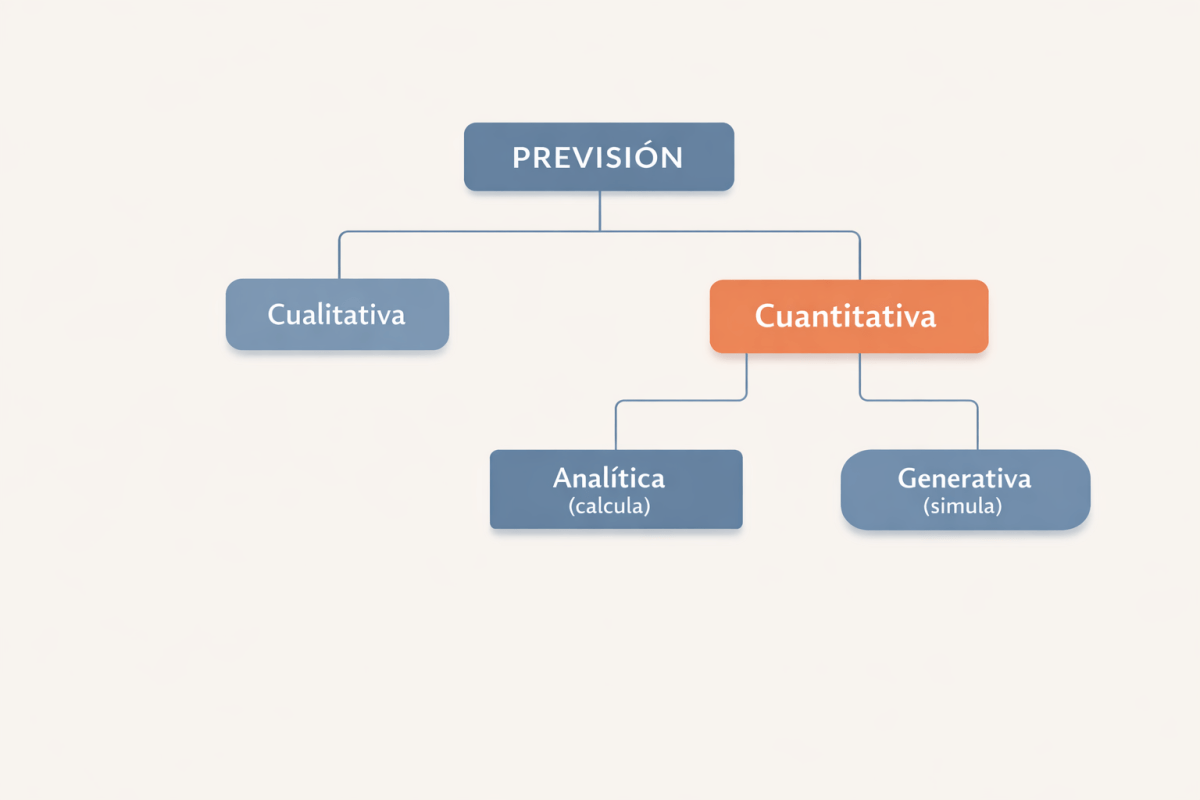

En un post anterior clasificábamos los métodos de previsión en dos grandes familias: cuantitativos y cualitativos. Dentro de los cualitativos podemos distinguir aquellos basados en juicio individual (opinión experta, analogías históricas, escenarios narrativos) y aquellos que intentan estructurar el juicio colectivo para reducir sesgos. El método Delphi pertene a esta segunda categoria.

No es predicción basada en datos en sentido estricto porque no parte de series temporales ni modelos matemático pero tampo es simple intuición. Es, probablemente, el intento más sofisticado del siglo XX de convertir el juicio experto en una herramienta sistemática de predicción.

Este método nació además en un contexto donde equivocarse podía significar una guerra nuclear.

(más…)

Predicción cuantitativa por simulación: cuando proyectar no basta y necesitamos recrear el sistema

En el post anterior vimos cómo la predicción cuantitativa analítica parte de una estructura estimada y la proyecta hacia el futuro. Funciona especialmente bien cuando el fenómeno es relativamente estable y las relaciones pueden formalizarse mediante una ecuación o función. Pero no todos los sistemas se comportan así.

Hay contextos donde:

- Las interacciones entre elementos generan dinámicas emergentes.

- La incertidumbre es central y acumulativa.

- Los resultados no dependen de una única trayectoria, sino de muchas posibles.

- El comportamiento futuro depende de decisiones que se retroalimentan.

En estos casos, en lugar de resolver un modelo, necesitamos simular un sistema. Eso nos lleva a la segunda gran familia de la predicción cuantitativa: la predicción basada en simulación.

(más…)

Predicción cuantitativa analítica: cuándo usarla y cómo elegir modelo

En el post anterior vimos que la predicción no siempre empieza con datos y modelos: a veces lo más razonable es recurrir a estrategias cualitativas. Pero cuando el fenómeno es lo bastante estable, repetible y medible, la predicción cuantitativa ofrece algo muy valioso: un lenguaje común para comparar, evaluar y mejorar.

Ahora bien, dentro de la predicción cuantitativa conviene hacer una distinción fundamental porque no todos los modelos numéricos funcionan igual.

- Algunos resuelven una estructura matemática estimada a partir de los datos y producen una predicción directa.

- Otros, en cambio, recrean el sistema múltiples veces mediante simulación, generando dinámicas posibles y distribuciones emergentes.

Este post se centra en la primera familia: la predicción cuantitativa analítica.

(más…)

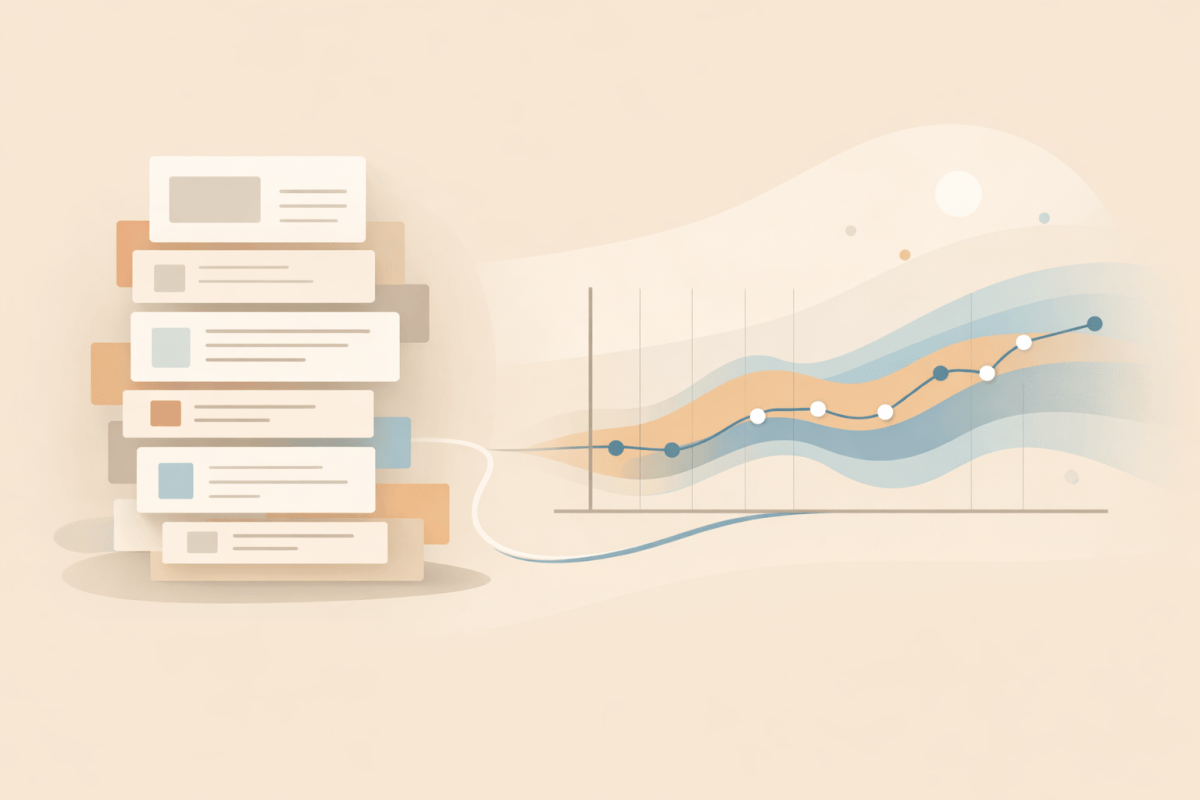

Predicciones cualitativas: cómo predecir antes de cuantificar

Cuando se habla de predicción, la conversación suele girar rápidamente hacia modelos cuantitativos, datos y algoritmos. Sin embargo, en muchos contextos reales, la mejor estrategia predictiva no es cuantitativa, ni tampoco una simulación formal.

Antes de números, a menudo solo hay experiencia, analogías, narrativas plausibles y/o juicios informados.

A eso lo llamamos predicción cualitativa y lejos de ser un recurso “menor”, es una estrategia legítima y, en muchos casos, necesaria.

1. ¿Cuándo conviene usar predicción cualitativa?

La predicción cualitativa es especialmente útil cuando forzar una predicción cuantitativa sería artificial o engañoso. No siempre faltan datos; a veces lo que falta es estructura, comparabilidad o estabilidad.

Hay cuatro situaciones típicas:

(más…)

Un mapa de las estrategias de predicción

Hablar de predicción suele llevarnos demasiado rápido a los modelos: regresión, clasificación, redes neuronales, machine learning. Pero empezar por ahí es como aprender geografía memorizando capitales sin haber visto nunca un mapa.

Antes de entrar en técnicas concretas, algoritmos o librerías, conviene dar un paso atrás y responder a una pregunta más básica:

¿De cuántas formas distintas intentamos predecir el futuro?

Este post es el primero de una serie extensa dedicada a recorrer, con calma, las distintas estrategias de predicción. No empieza por el cómo se calcula, sino por el cómo se piensa un problema predictivo.

La imagen que encabeza este post resume ese mapa general. A lo largo de la serie volveremos a ella muchas veces.

(más…)

TBF crece: divulgación por un lado, predicción por otro

En la última semana he introducido algunos cambios importantes en la estructura del blog. No son solo ajustes estéticos: responden a una idea más clara de para qué sirve cada parte del proyecto y de cómo quiero que se utilice este espacio para aprender a pensar mejor sobre datos, incertidumbre y decisiones.

A partir de ahora, el blog se organiza en dos grandes ejes complementarios: Predicciones y Blog.

Una nueva página de Predicciones

He creado una página específica donde se recogen todas las predicciones que voy formulando. No como opiniones sueltas, sino como ejercicios explícitos de predicción probabilística.

(más…)

Reseña del libro «Máquinas Predictivas: La economía simple de la Inteligencia Artificial»

Introducción

Prediction Machines: The Simple Economics of Artificial Intelligence, publicado en 2018 por Ajay Agrawal, Joshua Gans y Avi Goldfarb, parte de una idea tan simple como potente: el principal impacto de la inteligencia artificial no es que las máquinas “piensen”, sino que reducen drásticamente el coste de la predicción. Y dado que toda decisión incorpora algún tipo de predicción, este abaratamiento tiene consecuencias económicas de gran alcance.

El libro se publicó cuatro años antes del lanzamiento de ChatGPT, anticipándose al auge masivo de la IA generativa y al debate actual sobre su impacto. En un momento en el que la IA aún se percibía como una tecnología especializada, los autores ya señalaban que el verdadero cambio no vendría de aplicaciones llamativas, sino de la incorporación silenciosa de la predicción barata en millones de decisiones cotidianas.

Desde una perspectiva económica y pragmática, la IA se presenta como una continuación de avances previos —como las hojas de cálculo o los sistemas de optimización— que transformaron la toma de decisiones al reducir costes. La diferencia ahora es la escala: pequeñas mejoras en precisión, aplicadas de forma sistemática, generan un valor enorme.

A lo largo del libro, esta tesis se desarrolla en tres grandes bloques: qué es la predicción desde el punto de vista económico, cómo su abaratamiento transforma decisiones y organizaciones, y qué implicaciones estratégicas se derivan de un mundo donde predecir es cada vez más barato, pero el juicio humano sigue siendo escaso y valioso.

(más…)

La tasa base: el punto de partida de toda predicción sensata

Cuando intentamos predecir algo —el precio de la vivienda, la inflación, la probabilidad de aprobar unos presupuestos o incluso el absentismo laboral— solemos empezar por las historias: explicaciones plausibles, datos recientes, señales llamativas. El problema es que, muy a menudo, empezamos por el lugar equivocado.

Antes de añadir matices, escenarios o modelos sofisticados, hay una pregunta más simple y más incómoda que deberíamos hacernos siempre:

¿Qué suele pasar, de media, cuando no sabemos nada más?

Esa respuesta es lo que llamamos tasa base.

¿Qué es exactamente una tasa base?

La tasa base es la frecuencia histórica con la que ocurre un evento en una población o contexto comparable. No explica por qué ocurre algo, solo con qué frecuencia ocurre normalmente.

Ejemplos sencillos:

- ¿Qué porcentaje de proyectos públicos se retrasa?

- ¿Cuántos años, de media, la inflación supera el 3 %?

- ¿Con qué frecuencia se prorrogan los presupuestos en sistemas parlamentarios fragmentados?

La tasa base no pretende ser brillante. Pretende ser estable y ahí está su fuerza.

(más…)

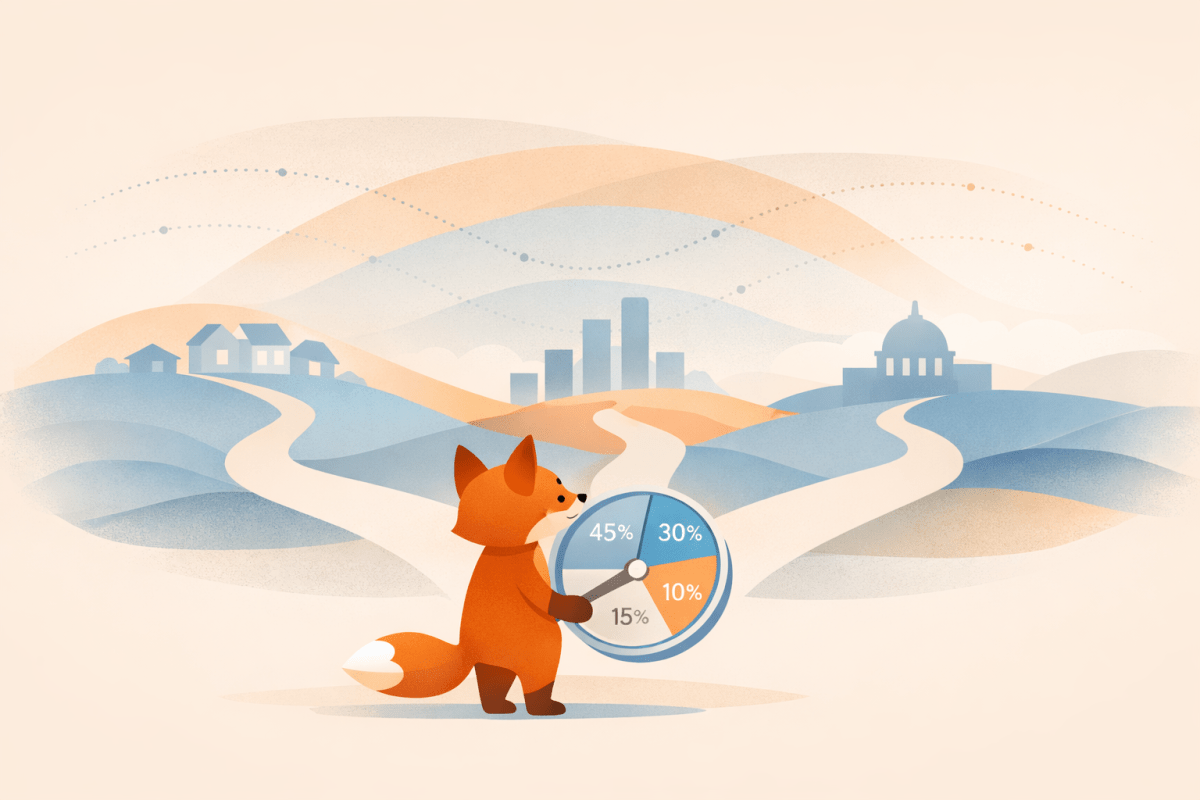

Tres predicciones para 2026: un ejercicio explícito de incertidumbre

Hablar del futuro suele llevarnos a dos extremos igual de poco útiles: la seguridad impostada (“esto va a pasar”) o la renuncia total (“nadie puede saber nada”). Entre ambos hay un espacio mucho más interesante: el de las predicciones probabilísticas, aquellas que no eliminan la incertidumbre, pero la hacen visible y discutible.

Este post plantea tres predicciones evaluables para 2026 en España. Son tres pronósticos sobre eventos que, a mi juicio, se sitúan en una zona “Ricitos de Oro”: lo bastante complejos como para no ser triviales, pero con información suficiente como para permitir un análisis razonado, y con decisiones reales en juego. Además, son especialmente relevantes en mi entorno.

No están pensadas para impresionar por su precisión puntual, sino para dejar constancia del razonamiento que hay detrás: qué factores considero importantes, cuáles pesan más y, sobre todo, qué tipo de evidencia me haría cambiar de opinión.

El compromiso es doble:

• Las predicciones se revisarán trimestralmente, recalibrando las probabilidades.

• A final de año se evaluará no solo el resultado, sino también la calidad del proceso seguido.

La burbuja de la IA: un ejemplo actual de cómo intentamos anticipar un Cisne Gris… con resultados inciertos

Con este post se culmina el recorrido iniciado al distinguir entre Mediocristán y Extremistán, al trazar los cuatro cuadrantes de Taleb y al explorar los sesgos —narrativos, de confirmación y de supervivencia— que nos impiden ver los eventos extremos antes de que ocurran. En el camino aprendimos que muchos fenómenos no fallan por falta de datos, sino por una mala comprensión del tipo de mundo en el que nos movemos. Los cisnes grises, esos eventos improbables pero imaginables, emergen precisamente en esa frontera. Y la llamada burbuja de la IA nos ofrece hoy un caso vivo para observar cómo intentamos anticiparlos… mientras seguimos atrapados en la incertidumbre.

Un cisne gris en directo

La inteligencia artificial no es una promesa vacía. Hay avances técnicos reales, mejoras de productividad tangibles y un cambio profundo en cómo se desarrollan productos y servicios. Precisamente por eso, la hipótesis de una burbuja resulta incómoda. No encaja bien con una narrativa basada en fundamentos sólidos. Sin embargo, que algo sea real no lo hace inmune a la sobrevaloración.

Aquí aparece el cisne gris: sabemos que los mercados tecnológicos pueden sobrecalentarse, sabemos que las historias de disrupción atraen capital de forma no lineal y sabemos que las expectativas pueden adelantarse muchos años a los resultados. Nada de esto es impensable. Lo difícil es integrarlo sin caer ni en el alarmismo ni en el entusiasmo acrítico.

(más…)Se ha producido un error. Actualiza la página y/o inténtalo de nuevo.