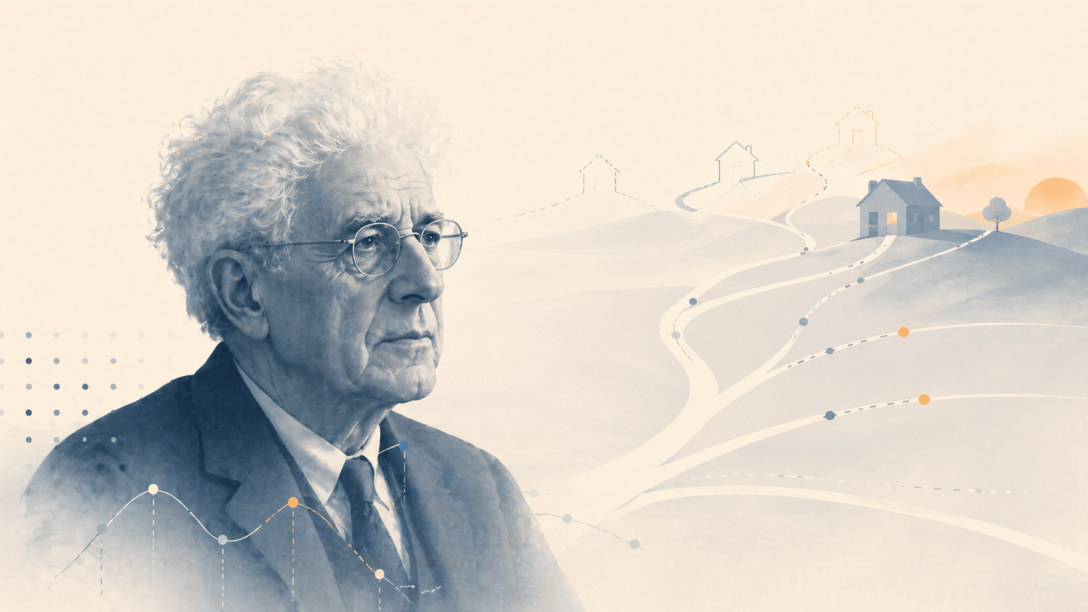

Finalizamos hoy nuestra serie dedicada a Pensar rápido, pensar despacio hablando de uno de los sesgos cognitivos más insidiosos: el sesgo retrospectivo, o como solemos decir coloquialmente, el “ya lo sabía”.

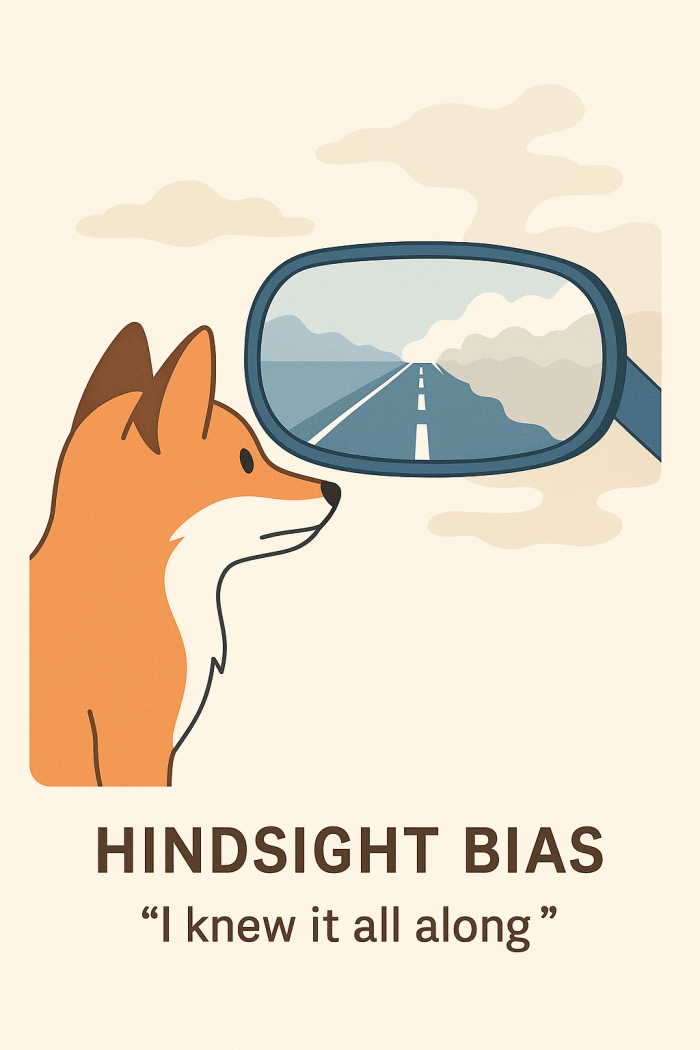

¿Cuántas veces has escuchado —o dicho— frases como “era obvio que iba a pasar”, “se veía venir” o “yo ya lo intuía”? Después de que algo ocurre, nuestra mente tiene una habilidad casi mágica para convencernos de que lo habíamos previsto. No se trata de arrogancia (aunque a veces se parezca), sino de una ilusión cognitiva: una reconstrucción engañosamente coherente del pasado.

¿Cómo funciona el sesgo retrospectivo?

El sesgo retrospectivo consiste en sobreestimar nuestra capacidad de haber predicho un evento una vez que ya conocemos su desenlace. En otras palabras, una vez que algo ha ocurrido, nos parece que era más predecible de lo que realmente era.

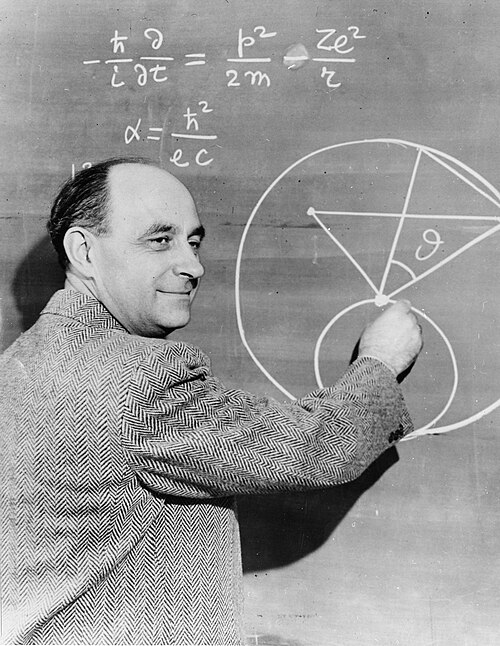

Kahneman y Tversky lo demostraron en múltiples experimentos. En uno de ellos, los participantes debían estimar la probabilidad de distintos desenlaces históricos o políticos. Cuando algunos de ellos conocían el resultado real, tendían a asignarle una probabilidad mucho mayor que los que no lo sabían. El conocimiento del desenlace no sólo cambia lo que pensamos, sino lo que recordamos haber pensado.

Seguir leyendo «“Siempre lo supe”: el engañoso poder del sesgo retrospectivo»