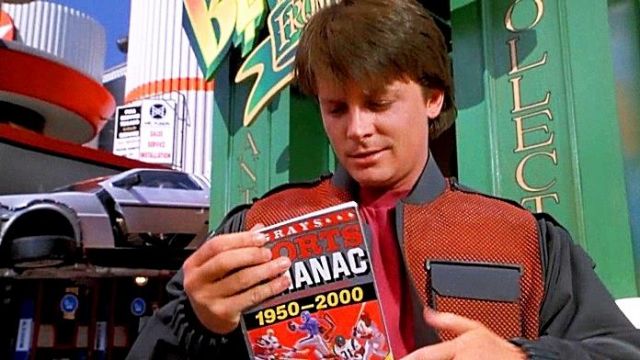

Continuando con la serie de posts donde exploramos las ideas clave del libro “Pensar rápido, pensar despacio” de Daniel Kahneman —una obra fundamental para entender cómo pensamos, decidimos… y, por extensión, cómo predecimos— hoy hablaremos de uno de los sesgos más persistentes y difíciles de detectar: el sesgo de anclaje, esa pequeña “ancla” mental que, sin darnos cuenta, tira de nuestras estimaciones hacia números que en realidad no tienen nada que ver con la realidad.

¿Qué es el sesgo de anclaje?

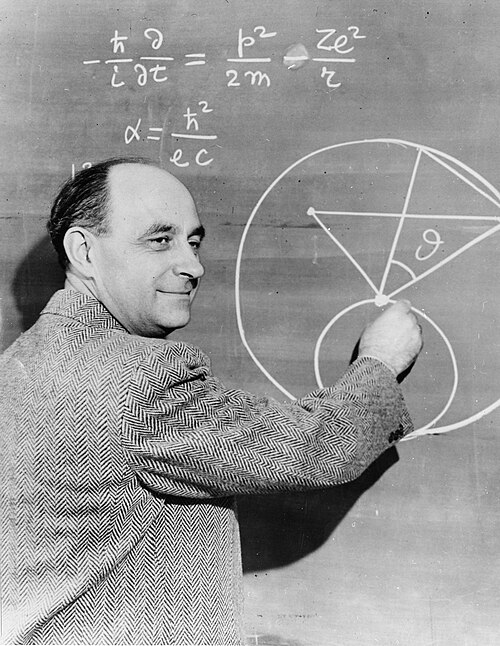

Kahneman y Tversky descubrieron que, cuando las personas deben estimar un valor —por ejemplo, el porcentaje de países africanos en la ONU o el precio de una casa—, sus respuestas se ven fuertemente influenciadas por un número cualquiera presentado antes, aunque ese número sea totalmente irrelevante.

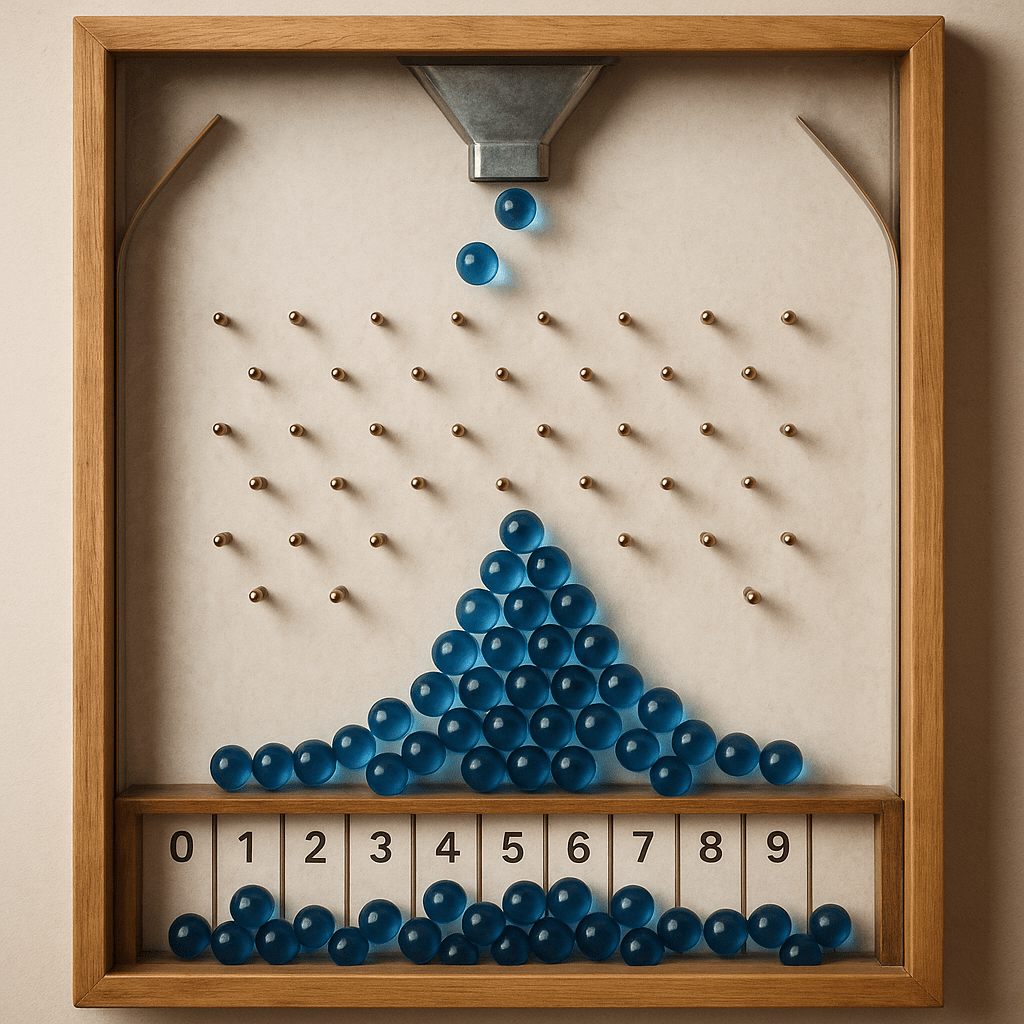

En uno de los experimentos más famosos del libro, los participantes giraban una ruleta trucada que sólo podía detenerse en el número 10 o en el 65. Luego se les preguntaba:

“¿Qué porcentaje de países africanos pertenece a la ONU?”

Los que habían visto el número 10 daban estimaciones en torno al 25%, mientras que los que habían visto el 65 decían alrededor del 45%.

El número aleatorio —que no tenía ninguna relación con la pregunta— ancló sus juicios.

Seguir leyendo «El ancla invisible que distorsiona tus predicciones»