Esta entrada, como las anteriores, parte de una idea clave del libro Superforecasting: The Art and Science of Prediction de Philip Tetlock y Dan Gardner. Allí se insiste en que hacer predicciones no es solo cuestión de acertar o fallar, sino de aprender a evaluar la calidad de nuestros juicios para mejorarlos con el tiempo.

Y para mejorar, primero hay que medir.

¿Medir qué exactamente?

👉 La calidad de tus predicciones.

En este post te presento tres conceptos clave para evaluar predicciones, especialmente si te interesa convertirte en un autèntico superforecaster:

- Calibración

- Resolución

- Métricas cuantitativas como el Brier Score o el MAPE

Calibración: ¿Tus predicciones reflejan bien tu nivel de certeza?

Imagina que haces 100 predicciones a las que asignas una probabilidad del 70 % de que ocurran. Si estás bien calibrado, deberías acertar en unas 70 de esas 100.

Eso es estar calibrado: tus probabilidades se corresponden con la frecuencia con la que realmente aciertas.

En Superforecasting, Tetlock destaca que los mejores pronosticadores no eran los más audaces ni los más conservadores, sino los mejor calibrados.

Ejemplo: Si siempre dices «Estoy 90 % seguro» pero solo aciertas el 60 % de las veces… tienes un problema de calibración.

Resolución: ¿Te mojas o siempre te quedas en el 50 %?

La resolución mide si tus predicciones son informativas.

Una persona que siempre responde “50 %” está perfectamente calibrada si los eventos suceden la mitad de las veces… pero no aporta nada útil.

La resolución premia a quienes diferencian bien los casos en los que algo es muy probable de aquellos en los que no lo es.

Alta resolución = te mojas cuando sabes más y dudas cuando sabes menos

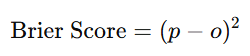

Brier Score: Un número para resumirlo todo

Aquí es donde entra en juego el Brier Score, una métrica que combina en un solo valor lo que acabamos de ver:

- Tu calibración (qué tan bien se ajustan tus probabilidades a la realidad).

- Tu resolución (qué tan informativas son tus predicciones).

¿Cómo funciona?

Se calcula como la diferencia al cuadrado entre tu probabilidad y el resultado real (1 si ocurrió, 0 si no):

- Si predijiste 0.9 y ocurrió: → 0.01 (muy bueno).

- Si predijiste 0.1 y ocurrió: → 0.81 (muy malo).

El resultado se suele promediar sobre muchas predicciones:

👉 cuanto más cerca de 0, mejor.

👉 un valor de 0.25 equivale a no aportar nada y quedarse siempre en 50 %.

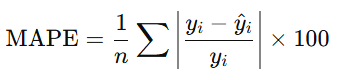

MAPE: Cuando predices un número

uando tus predicciones no son de eventos binarios sino de números concretos (ventas, temperatura, número de asistentes…), el MAPE es una buena métrica:

Donde:

- Yi: valor real

- ^Yi: valor predicho

Se interpreta como un porcentaje de error medio.

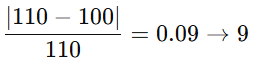

Ejemplo:

Si predijiste que asistirían 100 personas y fueron 110:

El MAPE ayuda a entender cuánto te alejas de la realidad, en media (en el ejemplo un 9%).

¿Qué podemos aprender de todo esto?

Evaluar nuestras predicciones no es opcional si queremos mejorar.

- La calibración nos ayuda a afinar nuestras probabilidades.

- La resolución nos empuja a ser valientes cuando toca.

- El Brier Score y el MAPE nos dan feedback claro y medible.

Como decía Tetlock, los superforecasters no nacen: se hacen.

Pero para mejorar, antes hay que medir.