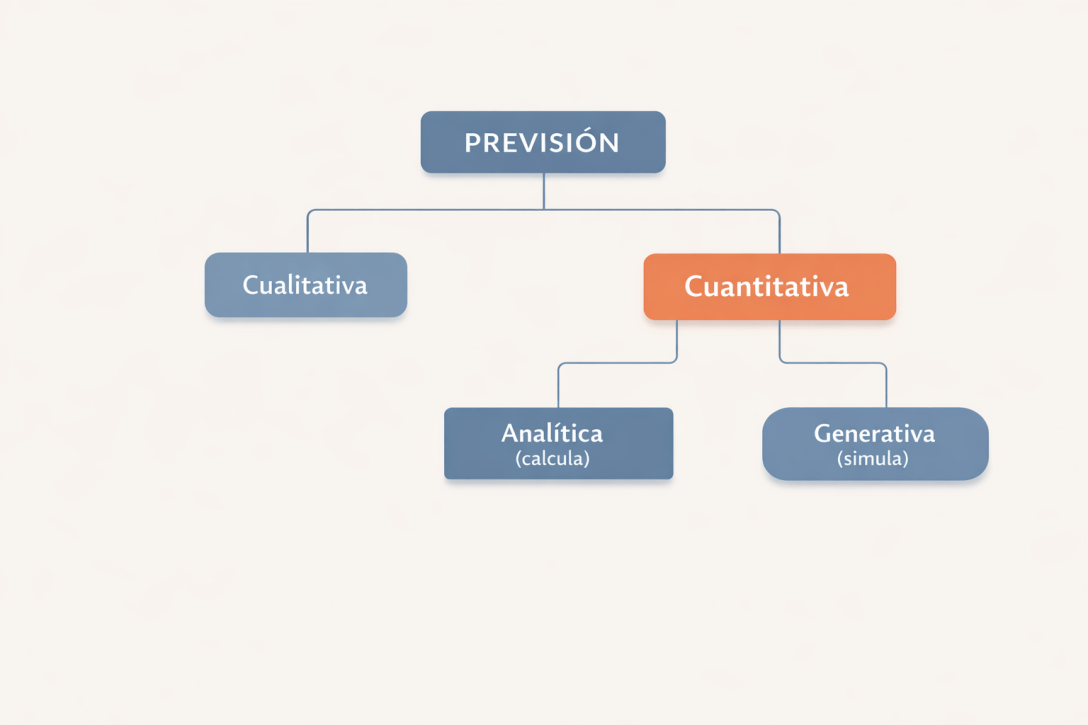

En el post anterior vimos cómo la predicción cuantitativa analítica parte de una estructura estimada y la proyecta hacia el futuro. Funciona especialmente bien cuando el fenómeno es relativamente estable y las relaciones pueden formalizarse mediante una ecuación o función. Pero no todos los sistemas se comportan así.

Hay contextos donde:

- Las interacciones entre elementos generan dinámicas emergentes.

- La incertidumbre es central y acumulativa.

- Los resultados no dependen de una única trayectoria, sino de muchas posibles.

- El comportamiento futuro depende de decisiones que se retroalimentan.

En estos casos, en lugar de resolver un modelo, necesitamos simular un sistema. Eso nos lleva a la segunda gran familia de la predicción cuantitativa: la predicción basada en simulación.

Seguir leyendo «Predicción cuantitativa por simulación: cuando proyectar no basta y necesitamos recrear el sistema»